홍콩과기대 광저우캠퍼스(港科广) 연구진이 3D 인체 생성 분야에서 혁신적인 돌파구를 마련했다. 단일 이미지에서 아(亞)밀리미터급 정밀도의 3D 인체 모델을 생성하는 MultiGO 기술을 개발해 CVPR 2025에 채택됐다고 발표했다.

분층 모델링으로 3D 인체 생성의 새로운 패러다임 제시

MultiGO의 핵심은 인체를 서로 다른 정밀도 단계로 분해해 단계적으로 세밀화하는 분층 건모(분층 모델링) 접근법이다. 이는 마치 레고 블록을 조립하는 것과 같은 원리로, 먼저 큰 블록으로 전체 윤곽을 구성한 다음 작은 부품으로 세부 사항을 보완하고 마지막에 재질과 텍스처를 처리하는 방식이다.

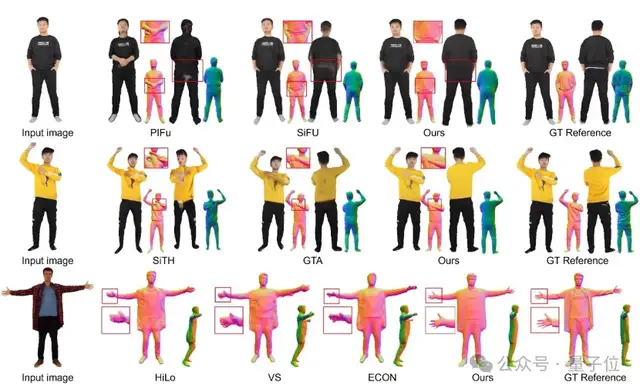

기존의 3D 인체 생성 기술들이 SMPL-X와 같은 인체 윤곽 사전 훈련 템플릿에 의존하면서도 세부 특징과 특정 해부학적 구조를 포착하는 데 한계를 보였다면, MultiGO는 다층 구조(골격, 관절, 손가락, 얼굴 등 부위의 미세한 주름)를 체계적으로 모델링해 이러한 문제를 해결했다.

3단계 기하학습 프레임워크의 기술적 혁신

MultiGO는 세 가지 핵심 모듈로 구성된 기하학습 프레임워크를 통해 기술적 돌파를 실현했다.

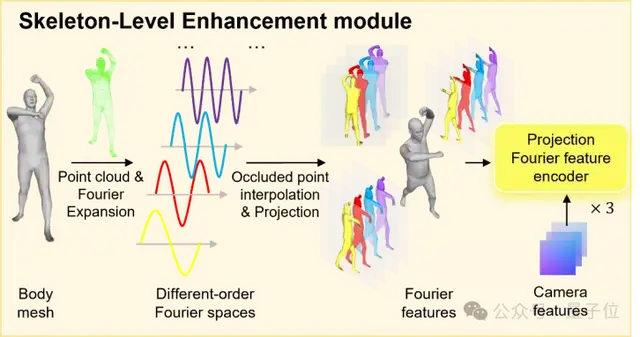

첫 번째는 골격 강화 모듈이다. 3D 푸리에 특징을 2D 공간에 투영하고 SMPL-X 인체 메시를 기하학적 사전 정보로 결합해 인체 골격 모델링을 강화한다. 푸리에 공간 위치 인코딩을 통해 3D 모델과 2D 이미지 간의 의미적 정렬 능력을 향상시켰다.

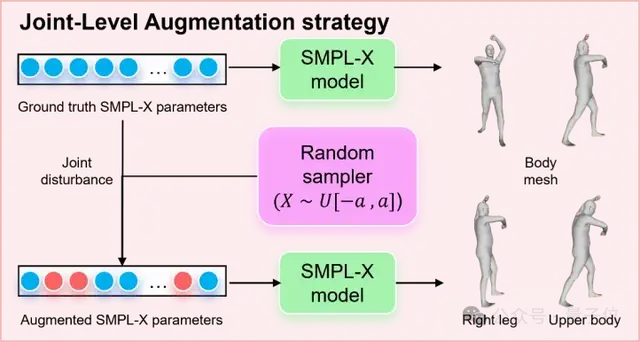

두 번째는 관절 강화 전략이다. 훈련 과정에서 관절점 위치에 섭동을 가해 깊이 추정 오차에 대한 모델의 견고성을 향상시킨다. 깊이 감지에 영향을 미치는 매개변수를 중점적으로 조정해 모델이 실제 관측에서의 구조적 편차에 더 잘 적응할 수 있도록 했다.

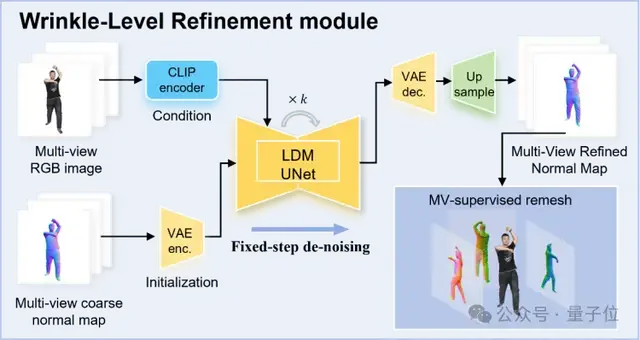

세 번째는 주름 최적화 모듈이다. 확산 모델의 디노이징과 유사한 방법을 채택해 표면 주름을 최적화 가능한 노이즈 패턴으로 간주한다. 거친 인체 메시에서 더욱 정밀한 고주파 세부 사항을 복원해낸다.

아밀리미터급 정밀도로 업계 성능 기록 갱신

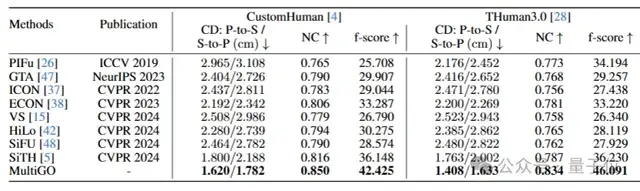

MultiGO는 CustomHuman과 THuman3.0 두 테스트 세트에서 최첨단 성능을 달성했다. CustomHuman 데이터세트에서 챔퍼 거리(CD) 0.180/0.406 향상, 법선 일치성(NC) 0.034 개선, f-score 6.277 증가를 기록했다. THuman3.0 데이터 세트에서는 CD 지표 0.355/0.369 향상, NC 0.047 개선, f-score를 무려 9.861 대폭 향상시켰다.

이러한 성능 돌파는 전통적인 단일 층차 모델링이 아닌 3단계 분층 모델링 전략을 통해 인체 기하학적 특징을 정밀하게 처리하고, 다층차 협동 최적화를 통해 인체 재구성 효과를 구현한 결과다.

다양한 응용 분야에서의 혁신적 활용

MultiGO의 분층 가우시안 모델링 기술은 인체를 서로 다른 정밀도 단계(기본 체형부터 의복 주름과 재질 텍스처까지 단계적 세밀화)로 분해하고, 가우시안 스플래팅 포인트를 3D 기본 요소로 활용해 효율적이고 고품질의 단일 이미지 재구성을 실현한다.

가상 의상 시착과 패션 전자상거래 분야에서는 소비자가 전신 사진 한 장을 업로드하면 고품질 3D 인체 모델을 생성하고, 시스템이 자동으로 다양한 의상의 착용 효과(의복 주름과 재질 세부사항 포함)를 시뮬레이션해 360도 관찰을 지원한다.

게임과 메타버스 영역에서는 사진 한 장으로 개성화 된 3D 가상 아바타를 빠르게 생성할 수 있다. 분층 구조는 유연한 조정(헤어 스타일, 액세서리 교체 등)을 지원하며, 가우시안 스플래팅 포인트의 특성으로 피부 텍스처와 광영 세부 사항을 보존해 가상 캐릭터의 사실감을 향상시킨다.

영상 특수 효과와 가상 제작 분야에서는 특수 효과 제작 시 배우의 단일 시각 사진 만으로도 고정밀 3D 모델을 재구성해 모션 캡처나 대역 합성에 활용할 수 있다. 분층 설계는 후반 작업에서 특정 층급을 별도로 편집(근육 라인 조정이나 상처 특수 효과 추가)할 수 있게 해준다.

이번 연구 성과는 단일 이미지 기반 3D 인체 생성 기술의 새로운 이정표를 제시하며, 향후 가상현실, 증강현실, 디지털 휴먼 등 다양한 분야에서의 광범위한 응용이 기대된다.

[논문 링크]

https://arxiv.org/pdf/2412.03103

[프로젝트 링크]

https://multigohuman.github.io/